Поделиться • 2 апреля 2025

ИИ научился думать как человек: каким будет новый этап развития мыслящих нейросетей

ИИ научился думать как человек: каким будет новый этап развития мыслящих нейросетей

Текст: Кирилл Пшинник, сооснователь и CEO онлайн-университета Zerocoder

Фото: сгенерированы c помощью Midjourney 6.1

Даже люди, далекие от изучения нейросетей, слышали про DeepSeek в первые дни после его запуска. О новом китайском проекте рассказывали все — от блогеров до федерального телевидения. Можно ли считать истерию вокруг мыслящей DeepSeek-R1 очередным хайпом или за такими технологиями будущее? Своими рассуждениями с «Инк.» поделился сооснователь и CEO онлайн-университета Zerocoder Кирилл Пшинник.

Даже люди, далекие от изучения нейросетей, слышали про DeepSeek в первые дни после его запуска. О новом китайском проекте рассказывали все — от блогеров до федерального телевидения. Можно ли считать истерию вокруг мыслящей DeepSeek-R1 очередным хайпом или за такими технологиями будущее? Своими рассуждениями с «Инк.» поделился сооснователь и CEO онлайн-университета Zerocoder Кирилл Пшинник.

Основной ажиотаж вокруг DeepSeek совпал с началом политической деятельности Дональда Трампа, который объявил о беспрецедентных инвестициях в $500 млрд на развитие ИИ. На этом фоне готовность Китая выделить 1 трлн юаней на эту технологию и заявления о нацстратегиях европейских лидеров общество восприняло неоднозначно: часть экспертов говорили о прорыве Китая в технологической гонке, другие открещивались и переживали за безопасность использования азиатской модели.

Хайп или прорыв

С анонса проекта прошло уже три месяца, а мы продолжаем обсуждать феномен DeepSeek-R1. Обычно хайп вокруг технологий не превышает двух месяцев и затихает, когда все стороны вопроса — от «внутрянки» до внешнего вида продукта — изучены, выводы сделаны, результаты оценены.

С точки зрения маркетинга, действительно, было удобно создавать искусственную истерию на фоне громких заявлений политиков, лидеров индустрии и экспертных комментариев. И достаточно логично на этой волне представить свои продукты, пусть даже иногда технологически больше похожие на полуфабрикаты, чем на полноценную новинку.

Если углубиться в детали, становится ясно, что мыслящая нейросеть, способная отображать логику своих рассуждений, анализировать информацию, делать выводы, исправлять ошибки и предоставлять обоснованные ответы — это настоящий технологический прорыв. Рассуждения были «зашиты» и в модель o1 с осени 2024 года. Но именно китайские ML-инженеры предложили подсмотреть за этим процессом, причем в формате open source модели.

Благодаря открытому коду пользователи и компании по всему миру теперь могут подключиться к проекту, развернуть собственную инфраструктуру и адаптировать технологию под свой периметр безопасности.

Не такой, как все

OpenAI o3-mini-high, Grok 3, Gemini 2.0, Claude 3.5 Sonnet и десятки других ИИ-моделей объединяет способность пошагово расписывать процесс своего мышления. После DeepSeek-R1 он всеобъемлюще охватил сферу нейросетей.

Особняком стоит лишь GPT-4.5, которая, по заверениям разработчиков, должна быть самой эмпатичной и дружелюбной. За первые дни тестирования стало понятно — она просто чуть лучше отвечает, чуть креативнее строит фразы. Но в ней нет reasoning (способности делать выводы), как в омникальных o1 и o3. Это одна модель, которую обещали в дорожной карте компании.

Даже Сэм Альтман сказал, что GPT-4.5 станет последней не размышляющей моделью из линейки нейросетей от OpenAI. Больше таких не будет — все последующие системы станут подробно объяснять, как они пришли к своему ответу.

К этой чете искусственных интеллектуалов присоединится и «Яндекс». Он тоже планирует выпустить первую в стране рассуждающую модель в ближайшее время, несмотря на санкционные ограничения на поставку чипов и логистические сложности.

Прорывной подход

Массовый переход на мыслящий формат нейросетей связан с тем, что одна методика создания ИИ сменила другую.

1. Раньше: Retrieval augmented generation (RAG), или дополненная поиском генерация. Подход, при котором нейросеть сначала находит нужную информацию во внешних источниках, а потом использует ее, чтобы сгенерировать ответ. Это крайне удобно при работе с документами — что человеческий взгляд может пропустить, модель не пропустит никогда.

Если запрос простой, то модели нужно просмотреть меньше документов или баз знаний, чтобы найти ответ. Для сложных или многокомпонентных вопросов приходится искать больше источников, проверять больше данных, что увеличивает нагрузку. А при детальном и подробном ответе нужно больше вычислительных мощностей и времени.

2. Сейчас: Retrieval augmented reasoning (RAR), или дополненное поиском рассуждение. Модель не просто ищет, а «размышляет», как бы вовлекаясь в диалог с источником — с датасетом. Это же уменьшает количество «галлюцинаций», то есть неверных ответов и откровенной лжи.

Чтобы все это стало реальностью, используются графы знаний. В них в том числе можно включать разного рода экспертную информацию, например нормативные акты, процедуры и законы, неформальные знания специалистов. Поэтому дополненное поиском рассуждение, RAR, умеет учитывать контекст — и показывать, как это происходит.

У этого есть и практическое применение. Когда процесса мышления не видно, мы просто не можем понять, почему нейросеть именно так ответила. С reasoning все как на ладони. К тому же это зачастую помогает осмыслить те аспекты задачи, о которых вы даже не задумывались. В совокупности мы приходим к развенчанию эффекта «зловещей долины»: мышление искусственного интеллекта становится ближе к человеческому. «Магия» развеивается и превращается в то, что можно понять.

Однако и тут есть свои нюансы.

- Генеративные модели стоят дорого, рассуждающие — еще дороже.

- Мыслящим нейросетям нужно больше ресурсов на многоступенчатую обработку данных, поскольку они проходят несколько этапов анализа информации (поиск, проверка, рассуждение и генерация ответа). Каждый этап добавляет вычислительные затраты и повышает стоимость ее использования.

- Для создания reasoning-моделей нужны более мощные сервера, хранилища и сети — это ведет к дополнительным тратам на эксплуатацию. Такие модели нужно постоянно дообучать и улучшать логику их рассуждений — это тоже дополнительные человеческие ресурсы и деньги.

Нужно финансировать исследования в области архитектур, которые основаны на логическом выводе, нужно сотрудничать с академическими кругами и договариваться о приобретении датасетов. Нужно вкладывать больше. Но в DeepSeek утверждают, что R1 обошлась в рекордно низкую сумму.

Нужно финансировать исследования в области архитектур, которые основаны на логическом выводе, нужно сотрудничать с академическими кругами и договариваться о приобретении датасетов. Нужно вкладывать больше. Но в DeepSeek утверждают, что R1 обошлась в рекордно низкую сумму.

Цена искусственной мысли

Стоимость такой разработки — $6 млн. Столько, по словам разработчиков, стоило обучение DeepSeek v3, на которой была основана размышляющая модель R1. Несмотря на эти астрономические цифры, в сравнении с затратами на OpenAI GPT-4 в $100 млн обучение R1 оказалось в разы дешевле.

Как же Deep Seek удалось так сэкономить на модели, которая соперничает с флагманскими нейросетями?

- Использовали по-максимуму доступное оборудование, вместо того чтобы закупать топовые решения. Компания закупила более дешевые графические процессоры (graphics processing unit, GPU) — NVIDIA H800 вместо NVIDIA H100. Компенсировали пропускную способность они при помощи качественного программного обеспечения и оптимизации кода.

- Разработчики сосредоточились на методе обучения с подкреплением — на решении задач, у которых есть четкие и легко проверяемые ответы, то есть на математике и программировании. Именно поэтому при проверке на бенчмарках у DeepSeek-R1 такие хорошие результаты именно в этих областях.

Альтернативной идеей было использование техники совместного сжатия ключей и значений (Low-Rank Key-Value Joint Compression). Сжатие данных помогло сократить объем без потери производительности, в результате чего модели потребовалось меньше памяти и вычислительных ресурсов. А это, в свою очередь, означает меньшие затраты.

Впрочем, не все верят, что модель действительно обошлась разработчикам в столь маленькую сумму. DeepSeek V3 обучалась на 2048 GPU H800 от NVIDIA, что действительно стоило бы в пределах $6 млн, но совершенно не факт, что обучение затребовало только одну итерацию. В стоимость включили только цену вычислительной системы, но не стоимость сбора и обработки данных, затрат на специалистов и многое другое.

Как бы то ни было, релиз DeepSeek-R1 все равно дестабилизировал ситуацию на рынке акций, в результате чего NVIDIA понесла серьезные потери. Как показала практика, для обучения высокомощной модели совсем не обязательно использовать процессоры самого последнего поколения.

Еще один шаг в будущее

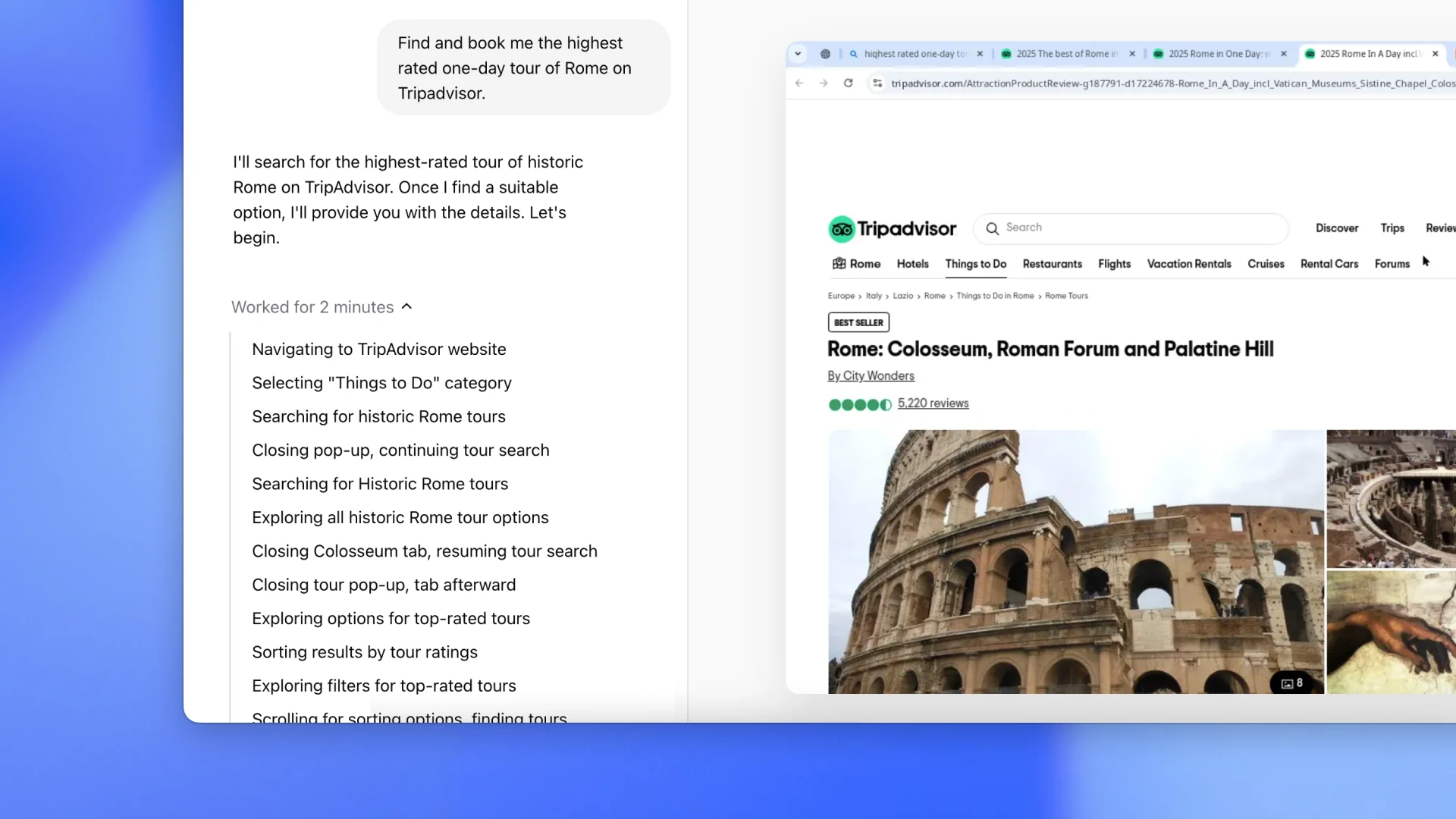

Одним из ИИ-трендов этого года стали автономные агенты искусственного интеллекта. Это системы, способные взаимодействовать с окружающей средой, анализировать ее и выполнять задачи без участия человека. В отличие от того ИИ, к которому мы привыкли, они не нуждаются в постоянных указаниях со стороны человека. Им можно просто ставить задачу — агент сам ищет оптимальный путь для ее решения.

Не случайно Альтман представил Operator — своего первого ИИ-агента, который очень напоминает самоуправление системой через курсор мыши, но без участия человека, на длинной волне обсуждений мыслительных моделей.

Reasoning-модели уже представляют из себя предшественников автономных агентов. Их «мышление» сильно напоминает сознание человека. Если поставить перед моделью задачу решить математическое уравнение, она будет перебирать разные способы его решения, пока не отыщет оптимальный. При поиске решений доказательной теоремы, скорее всего, будет бесконечно перебирать подходы, пока не придет к лучшему способу.

Уже сейчас компании могут использовать способность ИИ к рассуждению для повседневных задач.

- Reasoning-модели помогают оценивать логику рассуждений, не просто угадывать, а последовательно анализировать данные и выдавать осмысленные выводы. Значительно снижается частота случайных или непоследовательных ответов.

- «Мыслящие» нейросети эффективнее адаптируются к новым задачам без необходимости постоянного переобучения. Они готовы анализировать контракты, финансовые данные и архивы, прослеживая закономерности и паттерны. Они обрабатывают визуальные графики и чарты, занимаются планированием и даже выполняют таски из составленного ими же списка дел; могут наталкивать исследователей на нужные идеи одним только процессом рассуждений и умозаключений.

Именно поэтому в Open AI считают тупиковым путем развитие генеративных моделей без открытого мышления. Reasoning-шумиха — не социальная истерия, а промежуточный шаг к выпуску независимых агентов.

Такие агенты могут бесконечно масштабироваться, потому что настроены на самообучение. Им не будет требоваться «подкормка» в виде нового контента. Их работа будет заключаться в самоанализе и генерации новых действий, что в конечном итоге приведет к результату, выполненному абсолютно без участия человека.