Угрозы AI: как не стать жертвой манипуляций роботов

Искусственный интеллект меняет мир. Одних (например, Илона Маска) такие перспективы пугают. Другие вкладываются в новые технологии: в 2016 году в AI инвестировано суммарно $26-39 млрд. Не дожидаясь «восстания машин», третьи предлагают новую этику: решение задач, эмоции и свободу воли в мире симбиотического разума. Чем человеческой морали грозит развитие искусственного интеллекта и как эти угрозы предотвратить (и не пытаться остановить прогресс).

Восстание умных машин: проблемы развития AI

Искусственный интеллект может фундаментально изменить человеческое общество, а масштаб изменений от его внедрения сопоставим с последствиями индустриальной революции.

По данным McKinsey, инвестиции в развитие этой технологии, в первую очередь со стороны таких IT-гигантов, как Alibaba, Amazon, Baidu, Google, Facebook и других, в 2016 году достигли приблизительно $26-39 млрд, что в три раза больше, чем в 2013. 90% средств направляется на внутренние R&D-разработки. Финансируют исследования, в первую очередь в области машинного обучения и робототехники, и крупнейшие индустриальные игроки: ABB, Bosch, GE, Siemens, — а также автопроизводители: BMW, Tesla, Toyota.

Писатель, член Ассоциации футурологов Алексей Турчин уверен, что в XXI веке искусственный интеллект может сравняться с человеческим. В ближайшие 10-20 лет будут значительные прорывы в распознавании речи и управлении роботами (в том числе автономными автомобилями). Турчин также убежден, что AI научится симулировать эмоции.

«Если вы все еще не задумались о безопасности AI, вы должны сделать это», — написал в августе в своем Twitter Илон Маск. Эта тема действительно беспокоит визионеров всего мира. Не будет ли искусственный интеллект губительным для человечества?

Очевидно, что у технологии есть огромный вредоносный потенциал. На ум сразу приходят голливудские сюжеты о восстании машин или матрице, о потере человеком контроля над сверхразумом. Пугают ситуации вроде той, что произошла недавно с ботами Facebook, внезапно перешедшими на язык, понятный только им.

Роботы-расисты: машины и мораль

Существуют и этические сложности. В список этических проблем использования искусственного интеллекта, обсуждавшихся на Всемирном экономическом форуме в Давосе в 2016 году, попал вопрос, как эта технология повлияет на поведение и взаимодействие людей.

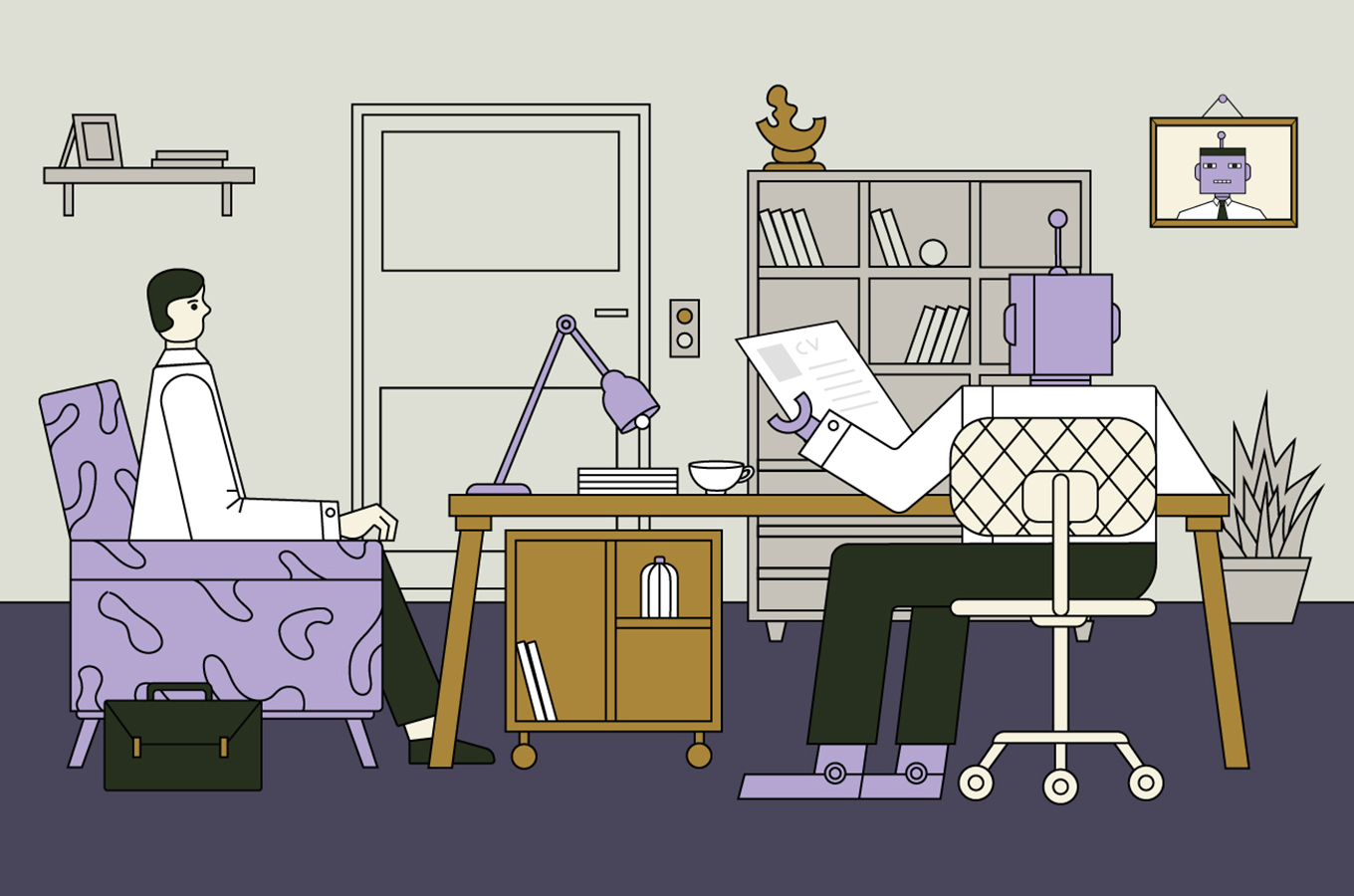

McKinsey Global Institute в своем исследовании указывает на другую проблему: в искусственный интеллект можно внедрить человеческие предубеждения — расизм, сексизм и т.д. Пока не ясно, какая мораль будет прививаться AI, но, усвоив человеческие предубеждения, он будет основывать на них свои выводы по выдачам кредитов, приёму на работу и т.п. Искусственный интеллект уже умеет распознавать не только очевидные пол и расу, но и сексуальную ориентацию.

Как избежать навязывания товаров и услуг со стороны искусственного интеллекта? Не будут ли приложения на базе AI манипулировать людьми, побуждая к тратам? Не попытается ли искусственный интеллект ограничить свободный эмоциональный выбор людей в целом, — как предполагает директор департамента взаимодействия науки, технологий и общества Московского технологического института, основатель Future Foundation Петр Левич.

Опасения вызывают и неверные решения, которые компьютер может подсказать врачу или судье. Кто будет нести ответственность за ошибки AI — разработчики, пользователи? Известный шведский философ Ник Бостром в своей работе «Этика искусственного интеллекта» пишет, что человек может вообще забыть или перестать понимать, почему AI советует поступить так, а не иначе.

Пожалуй, чаще всего обсуждается тема исчезновения ряда профессий из-за повсеместного внедрения искусственного интеллекта. Технологические корпорации серьезно относятся к этим опасениям, но думают, что вопрос решаем. Технологические гиганты, такие как Microsoft, в разработке искусственного интеллекта делают упор на усиление человеческих способностей и возможностей, а не на конкуренцию ИИ с людьми за рабочие места.

В ответе — все: зачем философам и социологам участвовать в разработке AI

AI представляет угрозу только в случае бесконтрольности. Необходимо управлять искусственным интеллектом, чтобы все люди получили равную долю возможностей от этой прорывной технологии. Ученый и философ Колин Аллен так пишет об этом в своей статье для New York Times: «Вместо того чтобы представлять машины с увеличивающейся степенью автономности от человека, мы можем представить машины, управление которыми просто требует большего внимания к этической стороне вопроса. Не идеальные машины, конечно, но лучше, чем могли бы быть».

Технологические гиганты уже создают специальные подразделения, которые будут давать советы по этическим вопросам разработки AI руководству корпораций. Amazon, Apple, Facebook, Google, IBM, Microsoft и другие компании недавно создали партнерство по AI, которое должно стать открытой площадкой для обсуждения проблем искусственного интеллекта и его влияния на людей и общество.

Комиссия по этике

Специальная надзорная комиссия Microsoft, созданная для гарантии ответственного использования ИИ, называется Aether (сокращённо от “AI and ethics in engineering and research” — «ИИ и этика в инженерных и исследовательских работах»). Задача комиссии, в состав которой входят руководители разных подразделений компании, — выявлять сферы потенциального злоупотребления продуктами Microsoft AI Research.

Похожая инициатива Google называется PAIR (“People + AI Research» — «Исследования «Люди + ИИ» ) и предполагает проведение и поддержку исследований взаимодействия людей и искусственного интеллекта — с фокусом на «человеческой» стороне. Google выделяет три основных направления: 1. Как личные качества разработчиков влияют на работу ИИ? 2. Как ИИ влияет на общество? 3. Как люди взаимодействуют с ИИ в повседневной жизни?

Несмотря на все риски, связанные с внедрением AI, государствам и компаниям не стоит затягивать с применением искусственного интеллекта — есть риск не успеть подготовиться к новым глобальным вызовам и возможностям. Например, системы образования должны уже сейчас начинать перестраиваться, чтобы готовить кадры не для соревнования с машинами, а дополняющие их работу.

Это значит, что образовательные учреждения должны фокусироваться на специальностях, требующих комплексного и творческого мышления. Машины в будущем будут выполнять монотонные, рутинные и несложные обязанности, которые люди с радостью им делегируют. Люди же смогут освободить время для более важных задач и видов деятельности.

Такое распределения областей ответственности в будущем должно быть проведено внутри каждой организации, государственной или частной. Нужно ввести правила, ограничивающие зону внедрения искусственного интеллекта в операционных процессах. В конце концов, искусственный интеллект разрабатывается не ради искусственного интеллекта, а чтобы новые возможности появились у людей.